如果你看过DeerFlow 2.0 能干什么那篇科普,你已经知道它能"一天干完你一周的活"。但这篇文章要回答的是另一个问题:它是怎么做到的?

DeerFlow 2.0 的核心是一套多智能体系统(MAS),由字节跳动开源,GitHub 上线 24 小时登顶热榜,目前已有 37k+ stars。它的架构设计有几个值得深入分析的工程决策,本文逐一拆解。

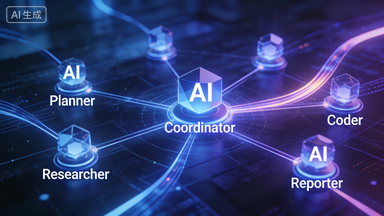

一、整体架构:四层角色分工

DeerFlow 2.0 的多智能体系统由四个核心角色组成:

| 角色 | 职责 | 状态 |

|---|---|---|

| Coordinator | 接收用户输入,判断任务类型,路由到 Planner 或直接回复 | 无状态 |

| Planner | 将复杂任务拆解为步骤列表,动态修订计划 | 有状态 |

| Research Team | Researcher(搜索/摘要)+ Coder(代码执行/数据分析) | 有状态 |

| Reporter | 汇总所有步骤结果,生成最终报告 | 无状态 |

这个结构和多智能体系统的本质与代价里分析的 Orchestrator-Worker 模式高度吻合,但 DeerFlow 2.0 做了一个关键的额外设计:Planner 和 Coordinator 是分开的两个角色。

为什么要把 Coordinator 和 Planner 拆开?

很多 MAS 实现会把"接收任务"和"拆解任务"合并成一个 Agent,逻辑上更简单。DeerFlow 2.0 选择拆开,背后有明确的工程理由:

- Coordinator 是无状态的:它只做路由判断,不持有任务上下文,可以快速响应、低成本调用。

- Planner 是有状态的:它需要持有完整的任务目标、已完成步骤、剩余步骤,状态管理复杂,需要单独的上下文窗口。

把两者合并,意味着每次路由判断都要携带完整的任务状态,Token 消耗会显著上升。拆开之后,Coordinator 的每次调用成本可以压缩到 Planner 的 1/10 以下。

二、Planner 的推理机制:不是简单的 Chain-of-Thought

DeerFlow 2.0 的 Planner 使用的是改造过的 ReAct(Reasoning + Acting)框架,但加入了一个标准 ReAct 没有的机制:计划修订循环(Plan Revision Loop)。

标准 ReAct 的循环是:

Thought → Action → Observation → Thought → ...DeerFlow 2.0 的 Planner 在此基础上增加了一个外层循环:

这个设计解决了一个真实的生产问题:LLM 生成的初始计划经常在执行到一半时发现前提假设是错的。

比如,用户要求"分析 2026 年 AI 芯片市场格局",Planner 可能在第一步搜索后发现某个关键数据源已经不可访问,这时候继续按原计划执行会浪费大量 Token。计划修订循环允许 Planner 在执行过程中动态调整后续步骤,而不是盲目执行到底。

Human-in-the-Loop 的工程意图

DeerFlow 2.0 的 Human-in-the-Loop 不是简单的"让用户点确认"。它的触发逻辑有明确的条件:

| 触发条件 | 说明 |

|---|---|

| 初始计划生成后 | 必触发,让用户确认任务理解是否正确 |

| 计划步骤超过 N 步 | 可配置阈值,默认 5 步以上触发 |

| 涉及外部写操作 | 如发送邮件、写入文件,必触发 |

| Planner 置信度低于阈值 | LLM 输出的 logprob 低于设定值时触发 |

三、Research Team:工具链与 RAG 集成

Research Team 由 Researcher 和 Coder 两个 Agent 组成,分工明确:

- Researcher:负责网络搜索、网页内容提取、信息过滤和摘要

- Coder:负责 Python 代码生成与执行、数据分析、图表生成

两者共享一个工具注册表(Tool Registry),工具调用通过统一接口抽象,底层实现可替换。

Researcher 的工具链

| 工具 | 类型 | 用途 |

|---|---|---|

| Tavily Search | 搜索 API | 主力搜索引擎,支持深度搜索模式 |

| Jina Reader | 网页解析 | 将网页转为 LLM 友好的 Markdown |

| DuckDuckGo | 搜索 API | Tavily 的备用方案(免费) |

| arXiv API | 学术搜索 | 论文检索专用 |

| Python REPL | 代码执行 | Coder Agent 专用 |

DeerFlow 2.0 的工具调用不是简单的"搜一次就用",而是实现了一个多轮搜索精炼机制:

第一轮搜索 → 提取关键实体 → 针对实体做第二轮精确搜索 → 交叉验证 → 输出这个机制的代价是显而易见的:Token 消耗会随搜索轮次线性增长。根据 DeerFlow 官方 GitHub 的 benchmark 数据,一个中等复杂度的研究任务(约 5 个子问题)平均消耗约 80,000-120,000 tokens,按 GPT-4o 定价约合 0.4-0.6 美元/次。

RAG 在 DeerFlow 2.0 中的位置

DeerFlow 2.0 支持接入本地知识库,但它的 RAG 实现和 Dify、FastGPT 这类平台有本质区别:

平台型 RAG(Dify/FastGPT):用户上传文档 → 向量化存储 → 检索时召回相关片段 → 注入 Prompt

DeerFlow 2.0 的 RAG:本地知识库作为 Researcher 的一个工具,和网络搜索工具平级,由 Planner 决定什么时候调用哪个工具

四、Token 经济学:一次深度研究任务的成本结构

根据 DeerFlow GitHub 仓库的 benchmark 测试数据(测试模型:GPT-4o,任务:生成一份 2000 字的行业研究报告),各 Agent 的 Token 消耗占比大致如下:

几个值得关注的数字:

- Researcher 占 45%:这是最大的成本中心。多轮搜索精炼机制是主要原因,每次搜索结果都需要 LLM 处理和摘要。

- Coordinator 只占 2%:印证了"无状态路由"设计的价值——把 Coordinator 做轻,是有意识的成本控制。

- Coder 占 20%:代码生成本身 Token 消耗不高,但代码执行失败后的重试(平均 1.8 次/任务)会显著推高这个数字。

对于关注 Agent 生产架构与 Token 成本控制的开发者来说,这个分布有一个重要启示:如果你想降低 DeerFlow 类系统的运行成本,优化 Researcher 的搜索策略比优化其他任何部分都更有效。

本地模型替换的可行性

DeerFlow 2.0 支持通过 OpenAI 兼容接口接入本地模型(如 Qwen2.5-72B、DeepSeek-V3)。但根据社区测试反馈,本地模型在以下两个环节表现明显弱于 GPT-4o:

- Planner 的计划质量:本地模型生成的计划步骤更容易出现逻辑跳跃,需要更多人工修订轮次

- Researcher 的信息过滤:本地模型对搜索结果的相关性判断准确率约低 15-20%,导致噪声信息更多进入最终报告

五、API 部署:从本地运行到生产服务

DeerFlow 2.0 提供了完整的 API 部署方案,核心是一个基于 FastAPI 的后端服务。

DeerFlow 2.0 的 API 部署有几个值得关注的设计细节:

流式输出(SSE):Agent 执行过程中的每个步骤状态都通过 Server-Sent Events 实时推送给客户端,用户不需要等待整个任务完成才能看到进展。这对于一个可能运行 5-10 分钟的深度研究任务来说,是必要的用户体验设计。

状态持久化:默认使用内存存储任务状态,生产环境建议切换到 Redis。任务状态包括:当前执行步骤、已完成步骤的结果、工具调用历史、Human-in-the-Loop 的等待状态。

并发限制:DeerFlow 2.0 默认不限制并发任务数,但由于每个任务的 LLM 调用是串行的(Planner → Researcher → Reporter),高并发场景下的瓶颈在 LLM API 的速率限制,而不在 DeerFlow 本身。

最小化部署配置

# 克隆仓库

git clone https://github.com/bytedance/deer-flow.git

cd deer-flow

# 配置环境变量

cp .env.example .env

# 编辑 .env,填入 OPENAI_API_KEY 和 TAVILY_API_KEY

# 启动后端服务

pip install -r requirements.txt

python server.py

# 启动前端(可选)

cd web && npm install && npm run dev生产环境部署建议加上:

REDIS_URL:启用 Redis 状态持久化MAX_PLAN_ITERATIONS:限制计划修订最大轮次(建议 3)MAX_SEARCH_RESULTS:限制每次搜索返回结果数(建议 5,平衡质量和成本)

六、开源协议与商业使用边界

DeerFlow 2.0 使用 Apache 2.0 协议开源,这意味着:

- ✅ 可以商业使用,不需要开源你的修改

- ✅ 可以修改后以不同名称发布

- ✅ 可以集成进闭源产品

- ❌ 不能移除原始版权声明

- ❌ 不能使用字节跳动的商标

Apache 2.0 是目前商业友好度最高的开源协议之一,这也是 DeerFlow 2.0 在企业用户中接受度较高的原因之一。

七、局限性:这套架构在哪里会出问题

1. 长任务的状态膨胀问题

当一个研究任务包含超过 10 个子步骤时,Planner 需要在每次修订时携带所有历史步骤的结果,上下文窗口压力显著上升。DeerFlow 2.0 目前没有实现自动的上下文压缩机制,这是一个已知的工程债。

2. 工具调用失败的级联效应

如果 Researcher 的某个搜索工具返回空结果或超时,Planner 的计划修订逻辑可能进入无限循环(不断尝试同一个失败的工具)。需要在部署时配置合理的超时和重试上限。

3. Human-in-the-Loop 的延迟问题

在全自动化场景(如定时任务)中,Human-in-the-Loop 的等待会阻塞整个流程。DeerFlow 2.0 支持配置 auto_approve=true 跳过人工确认,但这会失去对计划质量的把控。

总结

DeerFlow 2.0 的架构设计有几个值得借鉴的工程决策:Coordinator/Planner 分离降低路由成本、计划修订循环提升执行鲁棒性、Human-in-the-Loop 的量化触发条件。这些不是"字节特有"的设计,而是在生产环境中跑多智能体系统时普遍需要面对的问题的解法。

如果你在评估是否要基于 DeerFlow 2.0 构建自己的研究型 Agent,核心问题是:你的任务是否需要多轮搜索精炼?如果是,DeerFlow 2.0 的架构值得深入研究;如果你的任务是单次查询+生成,用更轻量的框架会更合适。

延伸阅读

想了解 DeerFlow 2.0 能做什么(而不是怎么做),可以看字节悄悄造了个"超级员工"那篇科普。

对多智能体系统的成本结构感兴趣,Multi-Agent 不是把多个 AI 堆在一起有更系统的分析框架。